基于深度学习的智能网联汽车驾驶行为决策模型研究

卞伟

江苏省应急管理厅 江苏省南京市 210000

智能网联汽车搭载了先进的感知器件、无线通信网络,具备定制计算的能力,能实现安全、有效、舒适的自主驾驶的智能网联汽车。其中的驾驶决策模块作为汽车的关键环节,决定着实际道路中汽车的驾驶安全性和性能水平。传统的驾驶决策方法包括基于专家知识的规则法、基于建模模拟的方法以及启发式算法,存在不灵活、难扩展、难以处理复杂场景等诸多问题。近几年的研究成果显示,深度学习技术在图像识别、自然语言理解和自主控制等领域展现出了优秀的人工智能优势,成了一种智能网联车辆驾驶决策的新方法。借助深度神经网络对大量传感器信息的特征表示能力,和使用强化学习在多种不同情况甚至是不稳定的路面场景中优化学习驾驶策略的能力,可提高驾驶决策的智能化程度。本研究的重点是开发基于深度学习算法的以车为主的车-网互动式网联汽车行为决策模型,其能够基于单车获得的信息、车联网信息等在各种情景下做出有效的独立决策,为车——网交互式网联汽车的实际应用提供理论和实践基础。

1 行为决策方法原理

1.1 算法原理

DDPG(梯度算法深度确定策略)是一种将深度神经网络加入的DPG 策略的一种方案,它是 DPG 策略中的一个子集。该方案通过引入深度神经网络来近似确定性的策略(μ),同时能明确行为值函(Q)。

从实际情况来看,DDPG 算法其中包括两个重要内容:确定性策略方法、神经网络作为函数逼近器,因此,此算法网络中也包含两个要点,分别为行动者、批评者,其具体的算法如下所示:

在以当前状态为主的情况下,可设置其为 S,并将其输入到参与者网络,可以得出输出动作,对应的a 为:

a=μ(s;θμ)+Nt

其中,a、s、μ、Nt、θ 和 θμ 分别表示的是:当前输出行为的值、当前状态、行为策略、随机噪声,神经网络进行更新时对应的值和描述网络的权重。

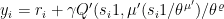

其中 y 表示下一步目标执行者与目标评价者获得的实时收益和实时输出之和;

ri 表示当前奖励值; γ 表示折现率;令 Yi 最小,得到初始 Q,使用平方差损失函数更新 criticnetwork 即 Q(Si,ai| θQ )。

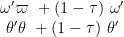

根据上述内容,可以对目标更新方式进行确定

其中,Actor 当前网络与 Target 网络对应的检查参数包括四个:分别为 θ、 θ′ , ω 、 ω′ , τ 为状态行为序列;该参数为实施软更新时需要的系数。

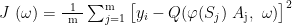

DDPG 方案在实施过程中,还存在一定的损失情况,对应的函数公式为:

就此公式来说,其各个字母均具有对应的代表性,而 φ(Sj) 表示的是特征向量。

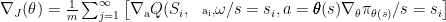

并能够根据以上结果,计算得出相关的策略梯度,其公式如下:

此公式中, H 、∇θπθ(s)和 Πn 对应的表示的分别时:采样空间、分值函数,批量梯度下降对应的样本数等指标。

1.2 算法流程

该部分以输入指令为主,主要涉及两个方面:一个是当前网络结构 (Actor) 和对应的最优状态 (Critic),其网络参数分别为 θ、 θ′ , ω 、ω′ 衰减因子 γ 、软性更新的系数 τ 、批量梯度下降中样本选取个数m 等参数;其次,目标 Q 网络的参数更新频率为 C,最大迭代次数为

T,以及随机噪声函数 Nt 的确定。确定上述参数后,则能获得目前最佳 Actor 网络参数θ 和最优Critic 网络参数ω。

2 所需构建的模型

2.1 面对交叉路口时的行为(驾驶状态)

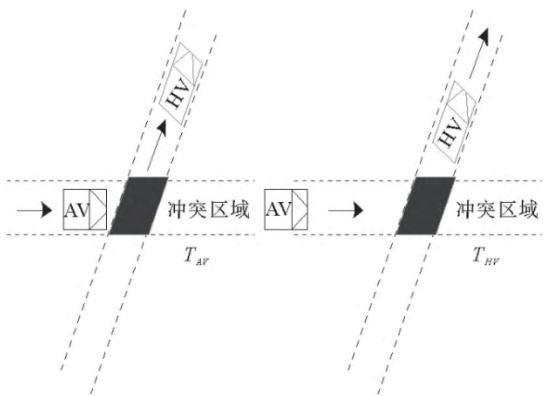

在当前研究中,我们考虑没有交通信号灯控制下的一个十字交叉口的问题。如果存在碰撞风险,则由无人驾驶技术控制的汽车可能会撞击由人工驾驶员控制的汽车,将碰撞危险部分用更深的灰色表示。由于车辆在任意时刻通过该交叉口,本节考虑由人的驾驶所导致的碰撞风险的建模。

2.2 模型的构建和效果的评价

减少踩刹车的使用可被认为是一种简单的降低油耗的方式,因此提倡环保型驾驶方式,这种行驶方式可帮助驾驶员掌握更平稳的加速和减速的技巧。环保驾驶包括采取绿色驾驶行为(避免行车过程中速度突变,并保持在高燃油效率的行驶速度范围内,这对提高燃油效率和降低排放有益)。指代式:选择能源消耗量最少、排放量最少的行驶路径。考虑到交叉口车—车发生冲突的场景,引入估计交通闯入时间滞后 EPET 参数,这是一个描述汽车经过冲突区的时间差,可以根据汽车从任何方向的角度,对事故发生概率进行精确的度量,如图 1所示。智能驾驶决定系统通过使用传感器获取周围车辆运行的信息,再根据这些信息调节车速以实现节能、省油以及降低排放的目的。如果智能汽车意识到邻近车道可能出现的车辆情况,则它们会适当地调节车速以避免紧急制动或加速,从而进一步减少能量浪费和排放有毒物质。

图 1 EPET 原理示意图

式中,TAV 和 THV 分别表示 AV 和 HV 到达冲突区的时间。EPET 大的情况下对应碰撞的概率小,则有:

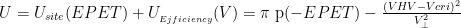

其中,效用函数U 值的大小对驾驶行为具有一定影响,此值越大,表明驾车行驶具有越优的行为;期望速度 VA 与 HV 相关,是交叉路口中 AV 和 HV 行驶速度,其中 VA 通常小于规定速度;设置 U 的值为负数,以便更容易看出模型通过能力。

3 仿真实验及其结果

3.1 仿真情况分析

展开算法训练,主要应用相关软件平台实现( OpenAIGym );模拟场景设计:选取复杂的多交通场景进行评估算法的能力,该场景中含有两名驾驶员车辆(HV)由北向南行驶,控制方法是对其进行智能化控制,能够以不发生事故和碰撞的情况下进行横过路口;同时将自动驾驶汽车(AV)作为研究对象,让其受到决策算法指导的条件是其不发生事故和碰撞;车辆的宽度与长度分别是4800mm×2178mm,车距可达 200m;此路段的最大行驶速度为 60km/h。DDPG 学习过程采用相似方案来搭建行为决策网络和判别网络,多层感知器的深度神经网络 (64-64),此外增加一个随机策略梯度的独立试探网络来提高DDPG 的学习效率。

3.2 不同算法的结果差异性

研究应用了多目标遗传算法,其基于非支配排序展开,这种方法(NSGA-II)主要包括精英机制,其可促进种群范围的有效扩大,并提升目标群体高效非支配排序的性能,有效减轻了算子的运算压力,使算法具有高效的运行性能和稳定性。

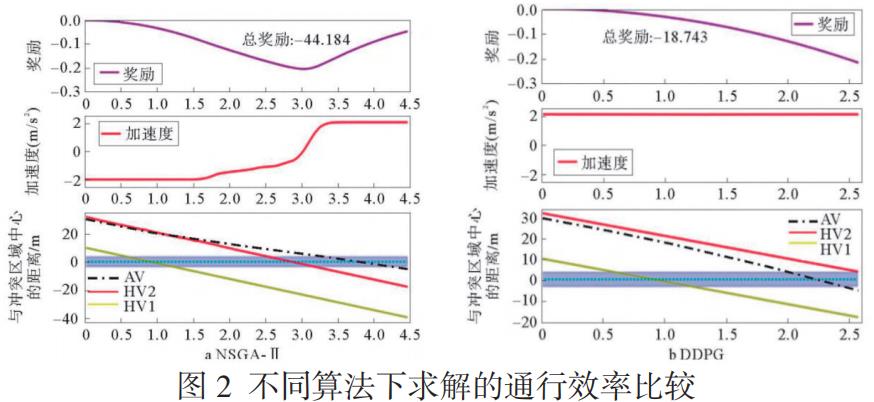

为了验证本文提出的算法,我们将其与 NSGA-I 算法进行比较,采用相同的环境条件进行两组试验。将 HV1 和 HV2 置于南北向起点南侧 10m 和北侧 32m 处,AV 置于东侧 30m 处(东西向)。HV1 和HV2 均以 40km/h 稳定行驶。我们分别基于 Nsgaii(b 组 ) 和 DDGP(a 组 )算法模拟本交叉口多目标优化,并针对两种算法进行试验测试,结果如图2 所示。

在 A 组测试过程中,汽车 AV 开始行驶过程中先减速以便给其他两辆汽车 HV1 与 HV2 让出车道,之后从第三秒开始,HV1 与 HV2离开十字路口后,AV 开始加速行驶然后过马路,在这一过程中,如行驶速度低于理想速度值(即未达到三秒行驶距离),则将获得的奖赏值减小,若高于理想速度值,则给予更大的奖赏值。A 组测试实验结果显示,获得的平均得分为 -44.184 分,如图 8a 所示。B 组测试实验中,汽车 AV 采用高效率过马路的方法,汽车 AV 利用穿过十字路口中间区域且在第二秒到达路口,比 HV2 提前半秒离开,利用DDPG算法找到最佳的行驶方法,使汽车在整个行驶过程中保持每小时两公里的加速度,其最终结果表现为总评价分数为 -18.743 分高于 A 组实验成绩。由该组测试实验结果可以看出,在 B 组测试实验中,AV 的行驶时间比A 组用时更短且在行驶过程中的加速度变化值也更小,因此可以说,该种控制方法的作用效果显著,对改善交通环境具有积极意义。

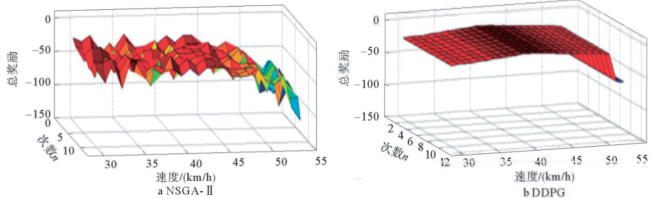

在对比结果分析中,对不同方法之间(DDPG 和 NSGA- Ⅲ)的鲁棒性进行对比,我们设计了一系列对比试验,使车辆(AV)的初始速度位于区间 30 ~ 55km/h 内。构建仅有 AV 的场景,并且利用训练好的 DDPG 为其规划合适的行动轨迹同时,我们以一种方法(NSGA-I) 为基础进行对照,保证十字路口相同,为同一个,并在此基础上进行重复实验(10 次),可见如图 3 的结果所示。可以看出,对于此问题而言,利用 NSGA-I 寻找方案时,每次实验都需要从头开始因此,在相同的初始车速条件下,每组实验的轨迹可能会不同;而DDPG 不需要重新规划最佳轨迹,结果更为稳定,因此它能够得到的累计回报的平均值要远远高于 NSGA-II。需要特别注意的是,如果起始车速达到或超过 50km/h,事故发生的概率会大幅度增加,因此两者累计回报的平均值均有所降低。

图 3 DDPG 和 NSGA-II 算法稳定性比较

结束语:智能化车辆决策方法的优化设计,可以对智能车辆应对各种交通状况决策的能力得到改善,并且保证其行车的安全。其中将多目标遗传算法进行应用,其效果显著,可在交叉路口的特殊情况下保证行车安全,改善拥堵情况,在行车方面提高效率。但由于受到“人-车-路(环境)”三者之间的相互干扰因素影响,智能车辆做出城市交叉口决策必然会有一定程度的局限性。因为文章篇幅所限,没有分析行人和非机动车辆、道路、流量等因素对车辆决策的影响因素。未来还会继续研究行人和非机动车辆、道路形态、道路流量等因素对车辆决策的影响,并加入行驶者的角色对车辆行为决策进行完善,实际道路上智能车辆行为决策模型予以细化。

参考文献:

[1] 姚福星 , 孙超 , 兰云港 , 等 . 基于混合专家模型的智能网联汽车换道决策方法 [J]. 汽车工程 ,2024,46(5):882-892.

[2] 陈意成 , 王韬 , 杨宇翔 , 等 . 基于贝叶斯博弈的网联自主车辆跟驰行为建模 [J]. 青岛理工大学学报 ,2025,46(3):133-140.

[3] 李伟强 , 权爱平 , 郭靖 . 智能网联汽车大数据分析与在线学习优化路径研究 [J]. 汽车维修技师 ,2024(18):64.

[4] 刘卫国 , 项志宇 , 刘锐 , 等 . 基于深度学习的端到端车辆运动规划方法研究 [J]. 汽车工程 ,2023,45(8):1343-1352,1361.

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)