基于可解释图神经网络模型的复杂网络攻击溯源方法

杨沐阳

山东省实验中学 山东省济南市 250001

1 引言

1.1 研究背景和动机

近年来,高级持续性威胁(Advanced Persistent Threat, APT)攻击事件频繁发生,对全球多个关键基础设施造成严重影响。例如,2017 年的 NotPetya 病毒通过供应链攻击导致全球航运与金融系统瘫痪,造成超过百亿美元的经济损失[1] ;2020 年SolarWinds 供应链事件渗透了超过 1.8 万家企业和政府机构,长期窃取敏感信息 [2] ;2021 年 Colonial Pipeline 因遭受勒索软件攻击,被迫关闭美国东海岸近半燃油管道,引发区域性能源危机 [3]。此类安全事件表明,当前网络攻击呈现出长期潜伏、高度隐蔽和跨域协同的特征。

根据IBM《2024 年数据泄露成本报告》,APT 攻击的平均潜伏期达到287 天,且75% 的混合型攻击包含三个及以上攻击阶段[4]。传统基于规则或静态图分析的检测方法(如Logistic 回归 [5]、静态图卷积网络GCN[6])存在明显不足:一是在时空关联方面表现较弱,难以捕捉非连续、离散且跨时间段的攻击事件[7] ;二是可解释性缺失,如 LSTM-AE 等深度学习模型虽可实现较高精度的异常检测,但无法有效定位关键攻击路径 [8],导致检测结果难以被信任,防御策略缺乏针对性。因此,亟需构建一种融合动态时空建模与概率可解释框架的新型攻击溯源方法,这也构成了本研究的核心目标。

1.2 相关研究

传统的基于规则的异常检测系统(如 Snort[9]、Suricata[10])在处理已知攻击模式时表现良好,但其严重依赖专家经验,难以应对新型或复杂攻击。当前,以数据驱动为主的网络攻击检测研究主要可分为以下三类:

在异常检测方面,机器学习方法(如支持向量机 [11])通过提取流量统计特征识别异常,但其效果高度依赖下游任务的特征工程,耗时较长且需大量领域知识 [12]。图神经网络(Graph Neural Network, GNN)因其对网络拓扑关系的强大建模能力,已成为攻击检测与溯源的研究热点。Xu 等人提出基于图卷积网络(GCN)的异常检测方法,在静态图上取得了 F1=0.87 的效果,但无法有效处理动态网络事件[13]。

在时序图神经网络方面,Rossi 等人提出的时序图网络(Temporal Graph Networks, TGN)在动态链接预测任务中准确率达到0.916,验证了时序建模对复杂交互行为的有效性 [14]。Yu 等人[15] 引入注意力机制增强GCN,将异常子图检测率提升至 93.5%,但模型决策过程仍缺乏可解释性,制约了其在实际安全场景中的应用。

为解决模型可解释性问题,可解释人工智能(Explainable AI, XAI)技术逐渐受到关注。Ying 等人提出的 GNNExplainer实现了节点级别的重要性归因 [16],但因未考虑条件概率依赖,在攻击溯源中的误报率较高 [17]。

1.3 现存挑战

由此可见,当前的复杂网络异常行为检测方法,仍然面临以下调整。

·异构日志的动态融合:网络数据流包含拓扑、时间戳与多模态操作特征,需实现多源异构数据的动态建模与权重分配 [18·长周期依赖建模:APT 攻击通常由多个稀疏步骤组成,需捕捉长时间间隔下的时空特征关

·因果可解释性验证:需通过可解释模型溯源对最终攻击贡献最大的关键路径,并验证其与真实攻击链的统计因果性[20]。

1.4 方法概述与贡献

针对上述挑战,本研究提出一种基于可解释图神经网络的的攻击溯源框架(Explainable Temporal GNN, ExpTGNN),创新性地融合动态图构建、连续时间动态图学习与因果推理技术,具体而言,主要创新点如下:·动态图构建引擎:提出一种动态图构建引擎,将原始日志转换为带权时态图结构,其中V 为图中节点集合,E 为边(事件)集合,为事件时间戳。

·双通道 GNN 模型:设计双通道 GNN 模型,将耦合时间编码器(Long Short-Term Memory, LSTM)与空间卷积器(GrapAttention Network, GAT)实现时空交织行为的联合建模。

·解释模块:引入解释模块,构建关键路径的约束,溯源攻击行为。

2 关键技术

2.1 时序图神经网络

时序图神经网络(Temporal Graph Neural Network, TGN)专用于建模动态图数据,融合了图神经网络与时间序列分析能力,可捕捉图中结构和属性随时间演化的规律。与静态图不同,时序图允许节点、边及特征动态变化(如社交关系、交易网络与安全事件日志等)。

根据时间粒度,图可分为四类:静态图、带时间权边图、离散时间动态图(DTDG)和连续时间动态图(CTDG)[21]。经典 GNN模型(如 GCN[22]、GAT[23]、GIN[24])适用于前两类。DTDG 由时间切片下的静态图快照构成,而 CTDG 以带时间戳的事件序列表示,涵盖边/ 节点的增删与特征变化。本研究采用CTDG 作为输入形式,因其具备更精细的时间分辨率。

与静态嵌入不同,时序图需学习动态节点表示。DeepCoevolve[25] 利用RNN 更新参与事件的节点嵌入;Jodie[26] 提出时间投影机制建模嵌入演化,但这类方法缺乏邻居聚合机制,易产生“陈旧嵌入”问题 [27]。为此,Zhang 等人提出 CoPE[28],Xu 等人提出TGAT[29],通过消息传递机制联合更新自身与邻居事件嵌入,显著增强模型表达能力。Rossi 等人提出的TGN[30] 统一了多数现有方法,成为当前代表性框架。

假设时序图模型的输入是一个事件序列 ,其中每个事件 表示节点 ui 和 vi 在时间戳 ti 发生了一次交互(边),边的属性为 att。其中,att 可以是交互特征,也可以是一个指示符,用于表示该事件是边的添加或删除。此外,ei 也可以仅涉及单个节点,即 ,用于表示节点级别的事件(如节点的添加、删除或节点属性的变化)。这些事件E 共同构成一个时序图  ,其中E 可视为带时间戳的边集合,而N 是E 中涉及的所有节点。由于G 和E 是相互定义的,下文将G 同时视为时序图和事件集合。

,其中E 可视为带时间戳的边集合,而N 是E 中涉及的所有节点。由于G 和E 是相互定义的,下文将G 同时视为时序图和事件集合。

本实验采用编码器 - 解码器框架,将不同时序图模型统一为编码器 - 解码器架构。编码器负责学习节点随时间变化的动态嵌入表示,解码器则利用这些节点嵌入进行下游预测任务(如未来边预测)。具体而言,Gi 令表示时间戳 t 之前构建的图(即包含事件 。编码器以 Gi 为输入,输出 Zi。其中 表示节点 n* 在 ti 时刻的嵌入。解码器通过预测节点对在该时间戳是否发生交互来构建损失函数(正样本为 ei={ui,vi} ,负样本为其余节点对)。因此,解码器利用 Zi 预测任意节点对新事件发生的概率,计算损失并通过反向传播梯度更新模型参数。

Encoder(Gl)→ Z (1)

为简化表示,用 表示包含编码器和解码器的训练好的时序图模型。 表示在 ti 时刻使用编码器基于 Gi 计算 Zi,并利用 计算事件e 的概率。

2.2 可解释图神经网络

可解释图神经网络(Explainable GNN)旨在揭示GNN 的决策依据,提升模型可信度。不同于“黑盒”GNN,可解释 GNN 能识别影响预测的关键子结构(如节点、边或子图),并生成人可理解的解释。随着 GNN 在医疗、金融与安全等领域的广泛应用,可解释性已成为实际部署的必要条件。

两类一:基种于常学见习方的法方是法通[3过2][扰33] 动利输用入多图个结实构例,训观练察归模纳型性输解出释的特变征化;[基31]于。搜关索键的单方元法被[3扰4][3动5] 时使,用输启出发显式著算变法化和。评基分于函扰数动(的如方Sh法ap分le为y值)搜索重要子集,但其计算开销较大。

此外,一些研究通过注意力机制[36] 或内部评分[37][38] 设计自解释模型。近期也有工作尝试解释时序图模型[39],但多基于离散时间快照,而本研究聚焦于连续事件流。因现有时序图模型较少考虑可解释性,本文主要研究实例级事后解释方法。

3 方法

3.1 方法概览

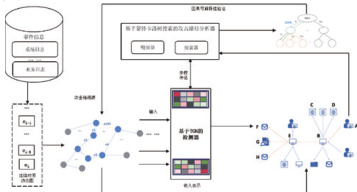

本节提出基于可解释图神经网络的复杂网络攻击溯源框架 ExpTGNN。识别目标攻击事件的关键前置事件属于组合优化问题,且因时序图中存在重复时间戳边与节点级事件,其搜索空间远大于静态图。为高效获取可解释的子事件集,本文设计了一种“嗅探 – 探索”双阶段框架(Sniffer–Excavator),其结构如图 1 所示。嗅探模块通过多目标事件训练,学习事件之间的归纳关联模式;探索模块则在嗅探结果的指导下,基于蒙特卡洛树搜索(Monte-Carlo Tree Search, MCTS)定位具体的关键事件集合。下文将详细介绍各模块的设计与实现。

图 1 ExpTGNN 模型框架

3.2 检测器

本文检测器以连续时间动态图网络(Temporal Graph Network, TGN)为核心架构,通过消息传递、特征聚合与记忆更新机制获取动态节点嵌入,并引入门控循环单元(GRU)建模事件间的长程因果关系。采用基于噪声对比估计的二元交叉熵损失函数,以最大化正样本与全局图的互信息,从而有效区分正常行为与攻击模式。该模型通过阶梯式训练策略显著提升了小样本场景下的检测精度与泛化能力,最终构建出能够高精度识别复杂攻击模式的高效检测系统。

3.3 解释器

解释器由嗅探器(Sniffer)和探索器(Excavator)两部分构成,旨在提升模型可解释性并精准定位关键攻击事件。嗅探器继承编码器结构,通过多层感知机(MLP)计算事件与攻击之间的相关性分数,其计算过程如下:score=MLP(encoder(Ei),encoder(Ej)) (3)

该分数用于量化不同事件与潜在攻击的关联强度。探索器依据嗅探器生成的相关性分数,采用蒙特卡洛树搜索(MCTS)算法探索关键事件子集,最终输出与攻击行为强关联的高影响力事件集合,显著增强检测结果的可解释性与可操作性。为有效识别与异常事件 Ek 对应的解释子图 Expk,本文在 TGNNExplainer [40] 方法基础上提出“嗅探 – 探索”框架(见图 1 右半部分)。嗅探器负责计算异常事件与其所有前置事件之间的相关性;探索器在嗅探器的引导下,使用 MCTS 算法输出最终的解释子图 Expk。该两阶段机制协同工作,能够从复杂事件流中精确识别攻击行为的因果路径。

3.3.1 嗅探器

该组件的核心功能是通过计算候选事件E 件E 的相关性得分 Hθ(Ej,Ek) ,为后续挖掘器的蒙特卡洛树搜索(MCTS)节点扩展过程提供优化依据。其设计突破传统随机掩码方法的局限,专门针对攻击事件关联性分析而优化。

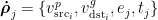

在输入数据建模时,目标事件用 ={vsrckp,vdstkg,ek,tk} 表示,候选事件用  表示,输入向量用ZEk,Ei=[vec(Ek),vec(Ej)]T∗ 示。采用复合向量转换函数 vec(⋅) 将原始事件数据转换为向量:

表示,输入向量用ZEk,Ei=[vec(Ek),vec(Ej)]T∗ 示。采用复合向量转换函数 vec(⋅) 将原始事件数据转换为向量:

vec(E)=[Tm(t),] (4)

其中: X′ 是节点特征矩阵的优化表示, 表示基于相对动态时间编码的可学习函数。

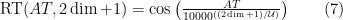

本文采用相对动态时间编码函数(RTE)[18] 计算时间间隔的嵌入表示:

RTE(AT) O= TimeLinear(RT(AT))RTE(AT)= TimeLinear(RT(AT))(5)

其中 AT 表示时间位置, 为可学习的线性投影函数, 是以下两项位置编码的通项

其中,dim 是从 0 开始的维度索引,u :时间编码的缩放因子(通常为编码维度总数)。该设计能有效增强源节点与目标节点的动态特征表示,精准捕捉节点间的时序关系。

后续将检测到的攻击事件及其所有前置候选事件输入 Hθ ,输出每个候选事件与攻击事件的相关性得分,得分结果用于指导挖掘器的蒙特卡洛树搜索过程。通过继承检测器微调阶段的编码器参数,并集成多层感知机(MLP),形成端到端的可解释性分析框架。

3.3.2 探索器

在探索器模块中,采用蒙特卡洛树搜索(MCTS)算法精确定位与攻击密切关联的事件。该过程通过多轮模拟迭代优化搜索树结构,最终输出最具解释力的事件子集。具体四阶段迭代过如下:

(1)选择(Selection):从根节点出发,根据选择策略迭代挑选子节点直至到(2)扩展(Expansion):基于检测器建议移除不重要事件,生成新的子节点

(3)模拟(Simulation):利用检测器的时序图模型计算新子节点的奖励值

(4)回溯(Backpropagation):将叶节点奖励值沿路径向上传播,更新各节点累积奖励

初始化阶段根节点应包含满足时空条件的候选事件集合。例如,当需要解释图 1 中攻击事件 时,编码器可见的根节点事件集为 {e1,e2,...,e99} 。最终获得最高奖励值的节点集合即为解释性结果。该机制通过空间约束(仅考虑候选事件相关边)时序约束(限定前置事件时间范围)动态剪枝(基于检测器置信度)实现攻击路径的高效溯源。

最终将获得最高奖励的节点集合作为解释性结果。具体机制如下所述:

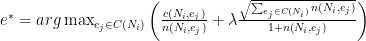

(1)节点选择策略: 在每个MCTS 搜索节点N 中,针对移除动作e*(从N 中移除事件e*),本文采用树结构上界置信区间(UCT)算法来平衡选择过程中的开发与探索。具体决策公式如下:

其中, C(Ni) 表示节点 Ni 下已扩展的事件集合, n(Ni,ej) 表示历史模拟中选择移除动作 ej 的次数, c(Ni,ej) 表示选择 ej获得的累计奖励,λ 代表探索权重系数。左项为开发项,代表优先选择平均奖励高的节点;右项为探索项,代表鼓励选择模拟次数少的节点。(2) 节点扩展策略优化 : 采用攻击关联性引导的智能扩展方法,通过预训练的嗅探器动态约束搜索空间,替代传统 MCTS 的全节点扩展模式。当选定节点 Ni 被判定为可扩展时,执行潜力评分计算 , 根据嗅探器输出筛选最优扩展节点:

e=argmin H(ej,ek) ejE(Ni\c(Ni))

在蒙特卡洛树搜索过程中,集合 Ni-C(Ni) 表示在先前模拟中未被扩展的事件集合。本实验通过移除最不重要的事件 e* 来扩展新节点,同时保留最具相关性的事件。借助从检测器继承的预训练嗅探器模块,能够以极小的计算成本高效推断事件关联分数。节点选择与扩展过程以交替方式进行:首先从根节点出发,扩展新的子节点;随后从根节点的原有子节点和新生成子节点中选取评分最高的节点进行转移;接着在新的节点位置重复执行扩展与选择流程。该迭代过程将持续进行,直至当前节点被判定为叶节点,或节点数量少于超参数时终止。

(3) 在模拟与反向传播阶段,检测模型首先计算叶节点 的奖励值 。随后执行反向传播,从叶节点到根节点的路径上所有节点Ni 均需更新参数:累计奖励值 c(Ni,e*) 通过累加叶节点奖励进行更新, Hc(Ni,e*)←c(Ni,e*)+r(Nleaf) ;同时节点访问计数 执行加 1 操作,  。此更新机制确保搜索过程能够动态记录各节点的历史表现信息。

。此更新机制确保搜索过程能够动态记录各节点的历史表现信息。

4 结语

本文提出了一种基于可解释图神经网络的复杂多步攻击检测与溯源框架 ExpTGNN。该方法通过引入连续时间动态图建模,实现了对复杂攻击行为时空关联的精准识别; 步融合蒙特卡洛树搜索算法,实现了对关键攻击路径的溯源与解释。本研究为网络攻击检测中的可解释性分析提供了新思路,并为应对日益复杂和隐蔽的安全威胁提供了有效工具。在未来的研究中,我们将致力于提升模型的内在可解释性。我们计划探索融合因果推理与结构学习的模型设计,以进一步增强其可信度与实用价值。

参考文献:

[1] Greenberg A. The Untold Story of NotPetya. Wired, 2018.

[2] FireEye. Highl Evasive Attacker Leverages SolarWinds Supply Chain. Technical Report, 2020.

[3] CISA. Cyber- Attack Against Colonial Pipeline. Alert AA21-131A, 2021.

[4] IBM Security. Data Breach Report 2024.

[5] LaValley MP. Logistic regression. Circulation, 2008.

[6] Kipf TN, Welling Semi-Supervised Classification with Graph Convolutional Networks. ICLR, 2017.

[7] Thapa Detection in Network Log Data. ACM Computing Surveys, 2022.

[8] Guidott Methods for Explaining Black Box Models. ACM CSUR, 2018.

[9] Roesch eigh trusion Detection for Networks. USENIX LISA, 1999.

[10] OISF. The Suricat Engine. https://suricata.io, 2023.

[11] Corte Vapnik t-Vector Networks. ML, 1995.

[12] Chandola tion: A Survey. ACM CSUR, 2009.

[13] Xu K Ho Networks? ICLR, 2019.

[14] Ro Deep Learning on Dynamic Graphs. ICML, 2020.

[15] Yu work for Anomaly Detection. IEEE TDSC, 2022.

[16] Ying tions for Graph Neural Networks. NeurIPS, 2019.

[17] Wu Evalua Neura Networks in Cyber Threat Detection. ACM SIGSAC, 2021.

[18] Han Multi-Source Log Analysis. IEEE TKDE, 2021.

[19] Tracing. ACM TOPS, 2022.

[20] Pea Th Book use and Effect. Basic Books, 2019.

[21] Holme P. Modern Review. Physics Reports, 2019.

[22] Kipf TN, Welling M. vised Classification with Graph Convolutional Networks. ICLR, 2017.

[23] Veličković al. Graph Attention Networks. ICLR, 2018.

[24] Xu K et al. How Powerful are Graph Neural Networks? ICLR, 2019.

[25] Li et al. DeepCoevolve: Learning Dynamic Node Embeddings. KDD, 2017.

[26] Kumar S et al. Jodie: Predicting Dynamic Embedding Trajectory in Temporal Interaction Networks. KDD, 019.

[27] Wang X et al. Dynamic Network Embedding: A Decade Review. IEEE TKDE, 2023.

[28] Zhang M et al. CoPE: Continuous-Time Dynamic Network Embedding. WWW, 2021.

[29] Xu D al. TGAT: Tempora Graph Attention for Dynamic Graphs. ICML, 2020.

[30] Ross E et Networks. ICML, 2020.

[31] Yuan Explainabilit Graph Neural Networks: A Taxonomic Survey. IEEE TDATA, 2022.

[32] Luo Parameterized Explainer for Graph Neural Network. NeurIPS, 2020.

[33] Shan Learning Graph Neural Networks. ICML, 2021.

[34] Lin thod Explaining GNN Predictions. AAAI, 2022.

[35] Fang Graph Classification. KDD, 2023.

[36] Va Need NeurIPS, 2017.

[37] Zhang Networks with Structural Attention. WWW, 2021.

[38] Detection via Neural-Symbolic Learning. ACM SIGKDD, 2022.

[39] Wang Explaining Dynamic Graph Models with Influence-Based Perturbation. ICDM, 2022.

[40] A. Sharma, S. Sharma and K. Singhal,“Explaining Temporal Graph Models Through an Explorer-NavigatorFramework,”2023 International Conference on Data Mining Workshops (ICDMW), Shanghai, China, 2023, pp. 271-278, doi: 10.1109/ICDMW60847.2023.00041.

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)