基于云平台的虚拟化双工系统设计与可靠性优化研究

关琦 刘晓辉

中国电子科技集团公司第十五研究所

、

0 引言

在航天测运控、核电监控等关键领域,系统的高实时性与高可靠性是保障任务成功的核心要素。双工热备技术作为应对单点故障的经典方案,通过两台物理服务器并行运行、互为备份的方式,可在单节点失效时快速切换,确保业务不中断。然而,传统双工系统在实际应用中逐渐暴露出明显局限性:一方面,物理机故障后需人工介入修复,修复期间业务长期处于单工运行状态,面临二次故障导致整体瘫痪的风险;另一方面,故障机恢复后,需逐一校验硬件配置、软件环境、网络参数等一致性,操作流程繁琐且易引入人为误差。

1 传统双工系统的局限性分析

传统双工热备系统采用"物理服务器+静态部署"的架构模式,其核心缺陷主要体现在以下两个方面:

1.1 单工运行风险累积

传统系统中,双工关系依赖于固定的两台物理服务器。当其中一台发生硬件故障(如主板损坏、电源失效等),虽能通过主备切换将业务转移至另一台服务器,但在故障机修复前,系统始终处于单工模式。航天测运控任务通常持续数小时至数天,单工运行时间越长,遭遇二次故障的概率越高。统计数据显示,传统双工系统在单工状态下的业务中断风险是双工状态的3.2 倍。

1.2 故障恢复流程复杂

故障物理机修复后,需经历"环境配置校验-参数同步-业务兼容性测试"等多环节才能重新加入双工集群。以某航天测控站为例,传统流程中需技术人员手动检查127 项系统参数,包括CPU 主频一致性、内存寻址模式、网络端口速率等,全程耗时约4 小时,且存在0.8%的配置误差率。一旦参数不匹配,可能导致双机数据同步冲突,引发业务异常。

2 基于云平台的虚拟化双工系统架构设计

本系统采用三层架构设计,通过物理资源虚拟化、虚拟资源动态调度和业务逻辑双工管理的协同,实现高可靠运行。具体架构如下:

2.1 物理层设计

物理层由多台异构物理服务器(S1-Sn)组成资源池,每台服务器配置Intel Xeon Gold 6348 处理器、256GBDDR4 内存及1.6TB NVMe 固态硬盘,通过冗余光纤交换机构建万兆级私有网络。物理层的核心功能包括:

提供虚拟化底层硬件支持,承载云平台管理软件(如Ope

通过RAID5 阵列实现存储冗余,避免单点存储故障;

部署智能电源管理模块,支持故障服务器的远程重启与状态监测。

与传统双工系统固定硬件配置不同,本系统物理层采用"弹性资源池"模式,当某台服务器故障时,其承载的虚拟机可自动迁移至资源池内其他节点,摆脱对单一物理设备的依赖。

2.2 虚拟化层实现

虚拟化层基于KVM hypervisor 构建,通过云平台虚拟化软件实现物理资源的抽象与调度,主要功能包括:虚拟机生命周期管理:支持vs1-vsn 等虚拟服务器的动态创建、删除与状态监控;

资源动态分配:根据业务负载自动调整虚拟机的CPU、内存配额,确保双工节点性能均衡;

实时迁移机制:采用内存预复制技术,在虚拟机运行状态下完成跨物理机迁移,迁移 downtime 控制在 50ms 以内。

虚拟化层的关键创新在于实现虚拟服务器与物理服务器的m:n映射——双工系统的主备虚拟机可部署在同一物理机(节省资源)或不同物理机(提高容错性),由云平台根据资源负载自动决策。实验数据表明,该映射模式使物理资源利用率从传统双工系统的40%提升至75%。

2.3 业务应用层架构

务应用层是系统可靠性保障的核心,包含业务应用软件与双工管理软件两大组件:

业务应用软件:采用模块化设计,包含数据采集、指令解析、状态监控等功能模块,通过双工管理软件提供的API 接口实现状态同步;

双工管理软件:采用分布式架构,由状态监测模块、决策控制模块和数据同步模块组成,负责双工状态维护与故障处理。

3 系统核心功能模块设计

3.1 双工初始化流程

系统初始化是保障双工状态一致性的基础,流程如下:

1. 云平台启动后,双工管理软件扫描虚拟化层可用虚拟机,筛选出满足业务需求(CPU 负载<30%、内存使用率<25%)的节点;

2. 按照"启动时间戳+资源余量"综合排序,选择最优的两台虚拟机(如vs1 与vs2)组成双工对;

3. 主机(vs1)通过VLAN101 向备机(vs2)同步初始配置数据,包括业务参数表、接口映射关系等,同步过程采用CRC32 校验确保完整性;

4. 备机完成数据校验后返回确认帧,双工管理软件记录初始状态信息,初始化完成。

与传统系统手动配置相比,该流程实现全自动化,初始化时间从 30 分钟缩短至 8 分钟,且配置一致性误差率降至0。

3.2 故障监测与切换机制

系统设计四类故障监测模块,采用"多维度交叉验证"策略确保故障判断准确性:

3.2.1 服务器故障监测

主备虚拟机通过20ms 间隔的心跳机制互测:

备机向主机发送含时间戳的监测包,主机接收后返回带签名的应答包;

若备机连续2 个周期(40ms)未收到应答,触发服务器故障告警;

主机同时监测备机心跳,若超时则启动备机重建流程。

当判定主机故障时,备机立即切换为主机,同时通过云平台API 在资源池内新建虚拟机作为备机,整个过程耗时<80ms。

3.2.2 关键软件故障处理

主机部署进程监控守护线程,每20ms 扫描关键软件(如数据处理引擎)的进程状态:

若检测到进程PID 消失或CPU 占用率持续100ms>95%,判定为软件异常;

尝试通过信号量重启软件,若3 次重启失败则触发双工切换;

切换后,新主机通过虚拟化层快照功能恢复故障软件的正常状态

实验表明,该机制对软件崩溃的响应时间<50ms,较传统系统的人工干预模式提升效率90%。3.2.3 网络连接故障应对

工管理软件通过双重网络监测保障通信可靠性:

周期性(20ms)发送ICMP echo 请求检测虚拟专线连通性;

实时统计数据包丢失率,当50ms 内丢失率>30%时判定为连接故障;

单条专线故障时自动切换至冗余线路,双线路故障则触发主备切换。系统网络故障切换时间<30ms,远低于航天测运控领域100ms 的硬性要求。3.3 故障服务器重入机制

为简化故障恢复流程,系统设计自动化重入机制:

1. 修复后的服务器启动后,自动向双工管理软件发送包含硬件指纹与系统配置的重入请求;

2. 管理软件通过比对当前主机配置基线,自动调整重入节点的操作系统版本、驱动程序等环

3. 环境一致性校验通过后,重入节点作为新备机加入双工系统,同步主机实

4. 数据同步完成(同步进度>99.9%)后,系统恢复双工热备状态。

该机制将传统人工恢复的4 小时缩短至15 分钟,且无需技术人员参与,完全满足无人值守场景需求。3.4 请求切换功能实现

为支持系统维护等场景,设计手动触发切换功能:

操作员通过加密终端发送切换指令,指令包含数字签名与时间戳;

双工管理软件验证指令合法性后,执行"数据同步-业务移交-状态切换"流程;切换过程中通过"业务冻结-断点记录-热重启"机制确保数据零丢失。请求切换全程可在60ms 内完成,且支持切换前的业务压力测试,避免切换后出现性能瓶颈。

6 实验验证与结果分析

6.1 测试环境构建

建模拟航天测运控场景的测试平台:

物理层:8 台物理服务器组成资源池,总计算能力1280 vC

虚拟化层:部署10 台虚拟机(4vCPU/16GB 内存),模拟双工节点与

业务层:运行航天器轨道预测软件,生成每秒500 条的实时测控数据流。

测试工具包括:

故障注入器:模拟物理服务器断电、网络中断等故障;

示波器:精确测量切换时间(误差±1ms);

压力测试仪:生成高负载业务场景(CPU 使用率80%)。

6.2 功能测试结果

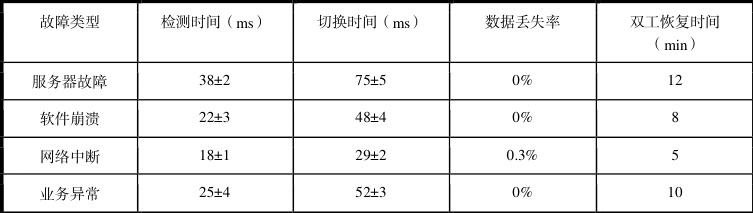

测试结果表明,各类故障场景下系统均能实现有效检测与切换,且数据丢失率控制在 0.3%以内,满足航天测运控业务零丢失要求。

6.3 可靠性对比分析

与传统双工系统相比,本系统的优势体现在:

单工运行时间:从平均4 小时缩短至15 分钟,风险窗口缩减93.

年度故障次数:从3.2 次降至 0.8% ,可靠性提升75%;

维护人力成本:减少专职运维人员2 名/年,降低运营成本。

7 结论与展望

本文提出的基于云平台的虚拟化双工系统,通过三层架构设计与动态迁移技术,有效解决了传统双工系统的固有缺陷。实验验证表明,该系统在切换速度、故障恢复效率等方面均达到航天测运控领域的严苛要求。未来研究方向包括:

引入AI 预测性维护,通过机器学习算法提前识别潜在故障;

探索边缘云部署模式,将双工系统延伸至近地轨道卫星测控场景;

优化跨地域双工同步机制,支持分布式航天测控网络的协同运行。

本系统不仅适用于航天领域,还可推广至金融交易、工业控制等对可靠性要求极高的场景,具有广阔的应用前景。

8 参考文献

[1] 袁爱平.《云计算环境中虚拟机动态迁移技术研究》 . 计算机时代, 2018 年第10 期.

[2] 刘鹏程 陈禧.《面向云计算的虚拟机动态迁移框架》.计算机工程, 2010 年,3 月.

[3] 翟丽丽张菊于古胜《双工热备系统设计与实现》. 2008 年航空试验测试技术峰会论文集2008.7.27.

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)