教育 AI 系统的可解释性机制设计研究

范骏

东方有线网络有限公司

前言

近几年,AI 技术飞速发展,教育 AI 系统引发人们的关注。研究教育 AI 系统的可解释性机制,可以清晰展示 AI 决策逻辑,帮助不同背景的师生理解、使用 AI 系统,有效识别、纠正 AI 系统中的潜在资源分配不均衡现象。但是,当前关于教育AI 系统的可解释性机制研究尚处于浅显阶段,无法为机制设计实践提供参考。为给教育 AI 系统的可解释性机制设计提供借鉴,本文提出围绕教育 AI 系统的作用分析可解释性机制设计难点、策略的论点。

1 教育 AI 系统的作用

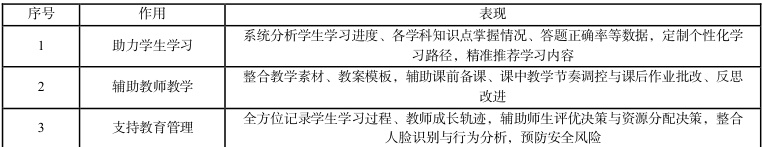

教育 AI 系统借助 AI 技术,驱动教育领域加速变革[1]。在教育领域,教育 AI 系统对学生学习、教师教学、教育管理均存在积极作用,局部见表 1。

表 1 教育 AI 系统的作用

由表 1 可知,教育 AI 系统不仅助力学生学习、辅助教师教学,而且支持教育管理。因此,学校应认识到教育 AI 系统的优势,积极应用教育 AI 系统,为师生发展与教育管理升级夯实基础。

2 教育 AI 系统的可解释性机制设计

2.1 教育 AI 系统项目背景分析

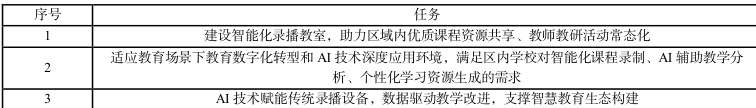

2024 年杨浦区录播教室设施项目为杨浦区教育信息化建设重点项目,由立项,立项总金额为118.08 万元,项目周期为 5 个月。项目内容是采购 14 套 AI 智能录播系统和 1 套便携式录播系统,集成 AI 自动导播、智能跟踪、语音识别、行为分析等人工智能技术,满足杨浦区 12 所义务教育阶段学校的需求。项目主要任务见表 2。

表 2 教育 AI 系统项目任务(局部)

由表 2 可知,教育 AI 系统项目的任务繁重,不仅需要适应教育数字化转型和 AI 技术的深度应用环境,满足区域学校AI 辅助教育、学习需求,而且需要立足智慧教育生态打造智能化录播教室,AI 赋能自动化课堂录制、内容分析、资源共享,支撑教师教研活动常态化。

2.2 教育 AI 系统的可解释性机制设计难点

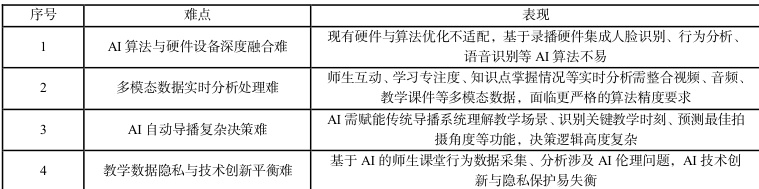

在 2024 年杨浦区录播教室设施项目开展过程中,可解释性机制是教育 AI 系统的重要组成部分,也是系统繁重任务完成的一环。教育 AI 系统可解释机制的设计难题重重,局部见表 3。

表 3 教育 AI 系统的可解释性机制设计难点(局部)

由表 3 可知,在教育 AI 系统的可解释性机制设计过程中,AI 算法与硬件设备深度融合、多模态数据实时分析处理、AI自动导播复杂决策、教学数据隐私与技术创新平衡等方面隐含诸多难题,直接制约教育 AI 系统的可解释性机制设计进程与效果。

2.3 教育 AI 系统的可解释性机制设计策略

面对 2024 年杨浦区录播教室设施项目中教育 AI 系统的可解释性机制设计难题,相关人员应从边缘 AI 计算架构的打造着手,围绕教育模型解释、教育数据与特征解释等功能需求,科学应用计算机视觉、自然语言处理等多模态 AI 融合算法,并聚焦教学场景复杂决策开发 AI 导播决策引擎。在这个基础上,设计人员应创新应用联邦学习技术,模糊化处理人脸信息,完善隐私保护 AI 技术方案,实现教学数据隐私与 AI 技术创新的平衡。

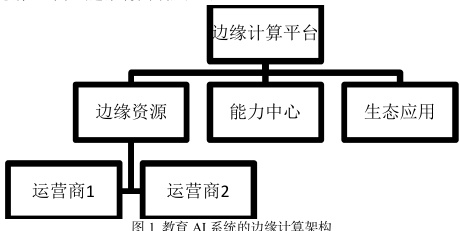

设计边缘 AI 计算架构,实现 AI 算法与硬件设备深度融合。边缘 AI 计算架构设计的关键是多接入边缘计算赋能 AI 任务,实现实时调度[2]。教育 AI 系统的边缘计算架构见图 1。

图 1 教育 AI 系统的边缘计算架构

由图 1 所示,设计边缘计算架构,实现录播设备端的轻量化 AI 算法模型部署,满足本地实时处理教育教学数据的要求。同时,针对传统录播设备硬件与高精度要求偏差,相关人员可 算架 识蒸馏、模型剪枝等模型压缩技术,将深度学习模型从GPU 版本优化为 CPU 可运行版本。以基于知识蒸馏与模型剪枝的模型组合压缩技术为例,优化流程见图2。

图 2 基于知识蒸馏模型压缩技术的深度学习模型版本优化流程

由图 2 可知,深度学习模型版本优化需要经历软标签生成、标签融合、离线蒸馏、量化感知、迭代剪枝等几个阶段。其中软标签是将模型的输出概率向量经温度参数进行软化后得到的多概率分布均值,将有标签数据与软标签融合训练模型,反向传播优化参数,协调处理精准性与模型压缩性能。

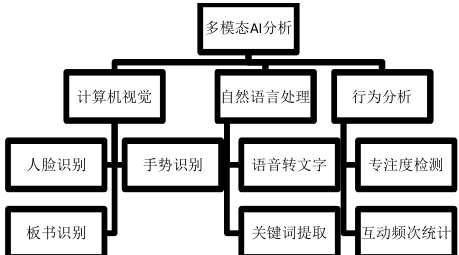

应用多模态 AI 融合算法,实现多模态数据实时分析处理。在成功实现 AI 算法在录播设备的边缘部署后,相关人员应根据教育数据与特征解释需求,利用时序数据融合技术,打造集计算机视觉、行为分析、自然语言处理为一体的多模态 AI 分析引擎。多模态 AI 分析架构见图 3。

图 3 多模态 AI 分析架构

由图 3 可知,多模态 AI 分析架构较为完善,可实现数据处理流水线处理,突出 AI 算法在教育场景的优良性能。其中,人脸识别模型的精度调优是多模态 AI 分析的前提,而基于语音识别方言适配与行为分析场景定制的大数据挖掘则是多模态AI 分析重中之重,应合理应用知识蒸馏、AI 语言表征等方法,逐一突破[3-4]。

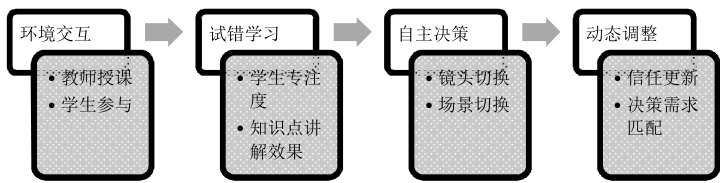

开发 AI 导播决策引擎,实现教学场景复杂决策。教育决策解释是教育 AI 系统可解释性机制的重要组成部分,面对传统导播系统在教育决策可解释性方面的不足,相关人员可引入强化学习算法,为上下文感知的智能导播决策提供支持。基于强化学习算法的 AI 导播决策关键是建立人智信任,通过重复信任博弈任务及强化学习计算建模,明晰人智信任建立过程的动态行为模式及内在机制[5]。决策机制见图 4。

图 4 基于强化学习的 AI 导播决策内在机制

由图 4 可知,基于强化学习的 AI 导播决策通过设备与环境持续交互获得教师授课习惯、学生参与度、师生互动频次、教学内容类型、重点知识讲解时长等多维度信息,开展试错学习,并反馈学生专注度变化、知识点讲解效果评估等信号,生成课堂教学分析报告,积累决策信心。在导播场景中,设备根据学习策略自主选择最佳拍摄机位和镜头切换时机,持续多次交互,逐步提高自主决策信任度。最终,基于教学场景知识图谱迭代触发策略重新评估,系统更新信任模型,实现导播决策与智能化课程无人值守录制需求相匹配。

完善隐私保护 AI 技术方案,平衡教学数据隐私与技术创新。数据隐私保护是 AI 技术应用的重要难题,涉及敏感信息收集、未授权数据共享、数据滥用等。为平衡导播技术创新与隐私保护,相关人员可创新联邦学习技术,将 AI 模型训练限制在本地设备,训练程序见图 5。

图 5 基于联邦学习技术的 AI 模型训练程序

由图 5 可知,在 AI 模型训练时,仅上传模型参数,避免原始数据隐私泄漏以及数据滥用。在 AI 模型训练过程中,针对人脸信息,进行模糊化处理,确保 AI 决策过程透明可解释。

综上所述,本研究结果说明了教育 AI 系统的作用,得出了教育 AI 系统的可解释性机制设计任务,论述了教育 AI 系统的可解释性机制设计难点与策略,突破了 AI 算法与硬件设备深度融合难题,解决了多模态数据实时分析及教学场景复杂决策问题,实现教学数据隐私与技术创新的平衡。研究期间通过边缘计算架构设计和多模态 AI 分析、决策引擎开发,人脸识别、语音识别准确率分别达到 96% 、 95% ,AI 自动导播决策准确率达 92%,满足区域 12 所学校基于数据驱动的教学改进要求,成为杨浦区教育 AI 应用的标杆案例。同时,本文对前人有关 AI 语言表征的多模态大数据队列设计方法做了验证,结合教育 AI 系统要求进行优化。但是,本次研究仍然存在待完善空间,如基于 AI 技术在教育场景的规模化应用方案不完善等,下一步将尝试深耕教育 AI 领域的产品化发展,提高 AI 在智慧教育市场的竞争优势。

参考文献:

[1]周磊.AI 大模型赋能成人教育:进展、挑战与对策[J].成人教育,2025,45(09):10-17.

[2] 周晓天, 孙上, 张海霞, 等. 多接入边缘计算赋能的 AI 质检系统任务实时调度策略[J]. 电子与信息学报,2024,46(02):662-670.

[3]朱周华,王蓓.结合 ArcFace 与知识蒸馏的口罩人脸识别方法[J].计算机应用与软件,2025,42(07):167-174.

[4]薛付忠.AI 语言表征的多模态大数据队列设计理论方法体系[J].山东大学学报(医学版),2025,63(08):1-16.

[5]谈昊天,李泽清,伍珍.AI 与人谁更可信?基于强化学习建模的人智重复信任博弈[J].心理科学,2025,48(04):920-932.

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)